量子コンピュータとRSAの脅威と対策

量子コンピュータとRSAの脅威と対策

暗号の話は抽象的に見えますが、筆者はまず小さな半素数 \(p=61, q=53\) でRSAの鍵生成から暗号化・復号までを手で追ってみるところから入るのがいちばん腑に落ちると感じています。

暗号の話は抽象的に見えますが、筆者はまず小さな半素数 \(p=61, q=53\) でRSAの鍵生成から暗号化・復号までを手で追ってみるところから入るのがいちばん腑に落ちると感じています。

そのうえで量子ビットを、コインが同時に表裏を向く不思議さではなく、干渉によって確率の山と谷を作る計算資源として眺めると、ShorがなぜRSAを理論上脅かすのかが見えてきます。

ただし、2025年の現実は「RSA-2048が今すぐ破られる」ではありません。

脅威の本体は、いま通信や保存データを盗んでおき、将来の量子計算機で解読するHarvest now, decrypt laterにあり、長く秘匿したい情報を持つ企業や実務担当者ほど、誇張ではなく順序だった備えが必要です。

本記事では、RSAの安全性の根拠からShorの本質、現在の量子ハードウェアの限界と資源見積もりの幅、そしてPQCへの移行と暗号アジリティまでを一本の流れで整理します。

読み終えるころには、暗号資産の棚卸しミニ・チェックリストを手元に、どこから優先して洗い出し、どこをハイブリッド移行の起点にするべきかを自分の言葉で説明できるはずです。

量子コンピュータはなぜRSAの脅威になるのか

量子計算の直感

RSAが量子コンピュータの脅威になる理由は、単に「新しい計算機だから速い」という話ではありません。

核心にあるのは、計算の進め方そのものが古典計算機と異なることです。

古典計算機のビットは 0 か 1 のどちらかを取りますが、量子コンピュータの量子ビット、つまり qubit は、0 と 1 を重ねた状態として扱えます。

ここが暗号の美しいところなのですが、この「重ねた状態」は曖昧さではなく、計算の途中で情報を波のように操作できるという意味を持ちます。

理想化して眺めると、n 個の qubit は \(2^n\) 通りの状態空間を表現できます。

古典計算機で n ビットのレジスタがその瞬間に 1 通りの値しか持てないのに対し、量子状態はその全体にまたがって広がります。

この見た目だけを切り取ると、量子計算は「候補を一気に全部試す機械」に見えます。

ですが、実際の強みはそこではありません。

量子計算で価値が出るのは、答えにつながる成分を強め、外れにつながる成分を打ち消すように計算を設計できるときです。

RSAに関して、その役割を担うのがShorのアルゴリズムです。

RSAの安全性は大きな合成数の素因数分解が難しいことに依存していますが、Shorはこの問題を量子計算の枠組みで捉え直し、周期を見つける問題へ変換します。

そこで量子フーリエ変換のような手法を使い、古典計算機では手こずる構造を効率よくあぶり出します。

つまり、RSAを脅かすのは「量子コンピュータ一般」ではなく、「素因数分解に対して効く量子アルゴリズムが知られている」という事実です。

ただし、理論と実機のあいだには距離があります。

いま動いている量子機は小規模な実験や特定タスクの検証では存在感を見せていますが、RSA-2048級を現実に崩すには、量子ビット数だけでは足りません。

誤り訂正、実行できるゲート数、計算を最後まで走らせる時間、そのすべてが揃って初めて脅威が形になります。

2025年時点では資源見積もりにも幅があり、必要な量子資源は前提次第で大きく動きます。

ここでは「量子ハードが進歩している」と「いま暗号実務を破れる」は同義ではない、と切り分けておくのが正確です。

重ね合わせ・もつれのやさしい説明

重ね合わせを直感的に言い換えると、「答えがまだ確定していない」のではなく、「複数の可能性に対して振幅を割り当てたまま計算を進める」状態です。

コインのたとえはよく使われますが、静止したコインが表と裏を同時に向いている、と受け取ると少し誤解が残ります。

筆者はむしろ、音叉を近くで鳴らしたときの響きの重なりを思い浮かべるほうが、量子計算の感触に近いと感じます。

コインは最終結果として表か裏しか返しませんが、音は重なると強く響く場所と、打ち消し合って弱くなる場所が生まれます。

量子計算の「確率振幅」も、それに似た振る舞いを見せます。

このとき登場するのが干渉です。

量子状態は単なる確率の一覧ではなく、互いに強め合ったり打ち消し合ったりできる量です。

だからこそ、量子アルゴリズムは正解候補へ向かう経路を増幅し、無関係な経路を減衰させる設計を目指します。

古典計算機で乱数をたくさん振って当たりを待つのとは、発想が違います。

もつれは、複数の qubit がばらばらではなく、一つのまとまった量子状態として振る舞う性質です。

2 個の qubit を別々に管理しているつもりでも、もつれた瞬間に「片方だけを独立に説明する」ことができなくなります。

暗号の文脈でこれが効いてくるのは、計算の中で相関構造を持たせられる点です。

Shorのアルゴリズムでも、単一の qubit が不思議なだけでは意味がなく、多数の qubit の関係を精密に保ったまま処理する必要があります。

ここで見落とせないのが、量子計算の繊細さです。

重ね合わせともつれは計算資源ですが、同時にノイズに弱い対象でもあります。

実際の量子ハードウェアでは、ゲート操作を重ねるほど誤りが蓄積しやすく、長い計算ほど結果を保つのが難しくなります。

Shorが教科書の上で成立することと、暗号破りとして実装できることの差は、まさにこの点にあります。

量子優位は魔法ではなく、問題に合ったアルゴリズムと、それを支えるハードウェア制御が噛み合ったときにだけ立ち上がります。

全部同時に試す誤解の整理

量子コンピュータの説明で最も広まりやすい誤解が、「全候補を同時に試して、正解をそのまま取り出せる」というイメージです。

これは半分だけ合っていて、半分は外れています。

たしかに量子状態は多くの候補を重ね合わせて計算できます。

しかし、測定した瞬間に取り出せるのは 1 回につき 1 つの結果です。

もし本当に全部の候補結果をそのまま読めるなら、未構造探索でも何でも一瞬で終わるはずですが、量子計算はそんな万能機械ではありません。

本質は、干渉で分布を偏らせることです。

正解に結びつく成分を目立たせ、間違いに結びつく成分を目立たなくしてから測定する。

だから量子優位は問題依存です。

構造がない問題では期待した加速が得られませんし、アルゴリズムが見つかっていない問題に対しては、量子ハードだけ進んでも答えは出ません。

RSAが特別なのは、素因数分解に対してShorという明快な理論的突破口があるからです。

逆に言えば、「量子コンピュータはすべての暗号を同じように破る」という理解は正確ではありません。

この点は実務でも効いてきます。

公開鍵暗号の代表であるRSAやECCはShorの射程に入りますが、共通鍵暗号は影響の出方が異なります。

量子時代の議論でPQCへの移行が中心になるのは、公開鍵の基盤が先に揺らぐからです。

国際的に標準化が進んでいるML-KEMML-DSASLH-DSAといった方式は、その前提で設計されています。

ℹ️ Note

量子脅威を評価するときは、量子ビット数だけを見ると見誤ります。RSA-2048級への現実的な脅威は、誤り訂正を含む論理量子ビットの確保、十分なゲート品質、そして計算を完走できる実行時間まで含めて判断する必要があります。

ハードウェアの進歩は着実です。

富士通と理研は 2025 年 4 月に 256 量子ビットの超伝導量子コンピュータを公表し、2026 年には 1,000 量子ビット級を目指す計画を示しています。

IBMも 2026 年に 120 量子ビットで 5,000 two-qubit gates 級を狙うロードマップを出しています。

ただ、これらは「量子計算の実力が上がっている」ことを示す材料であって、そのままRSA-2048解読の到達宣言ではありません。

暗号解読に必要な資源見積もりにはなお幅があり、前提が変われば必要量子ビット数や実行時間も動きます。

ハードウェアの進歩は着実です。

ただし、各社(富士通、理化学研究所、IBM など)が公表する「量子ビット数」やロードマップは研究開発上の公表値・目標であり、誤り訂正要件や論理量子ビット換算を含めた実運用での解読能力を直接示すものではありません。

出典を併記して企業のプレスリリースやロードマップを参照してください(例: IBM Quantum Roadmap そのため、RSAへの脅威を理解するコツは二つです。

一つは、Shorによって理論上の土台はすでに崩れていること。

もう一つは、実行可能性はハード、誤り訂正、回路深さの三拍子で決まることです。

この二つを分けて考えると、「今すぐ全面崩壊ではないのに、なぜ移行準備が進んでいるのか」が自然につながります。

量子コンピュータは万能ではありませんが、RSAに対しては、ちょうど急所に合うアルゴリズムが見つかっている。

その一点が、脅威の意味を決定づけています。

RSAは何に依存して安全なのか

公開鍵暗号の基本

RSAを理解する入口は、公開鍵暗号という仕組みそのものです。

公開鍵暗号では、誰に見られてもよい公開鍵と、持ち主だけが隠しておく秘密鍵を組にして使います。

公開鍵は南京錠、秘密鍵はその鍵だと考えると直感的です。

南京錠そのものは人に渡せますが、開ける鍵は持ち主しか持ちません。

RSAでは、この関係を整数の演算で実現します。

公開鍵で暗号化したデータは、対応する秘密鍵でしか元に戻せません。

逆に、秘密鍵で作った署名は公開鍵で検証できます。

ここが暗号の美しいところなのですが、公開鍵は広く配ってよいのに、そこから秘密鍵を逆算するのは現実的ではない、という片方向性が成立しているからこそ、インターネット上で安全な通信や電子署名が成り立ちます。

その片方向性の土台になっているのが、大きな合成数の素因数分解の難しさです。

RSAでは、2つの素数 \(p\) と \(q\) を掛け合わせて \(n=pq\) を作ります。

掛け算そのものは簡単ですが、できあがった \(n\) から元の \(p\) と \(q\) を見つけるのは難しいという非対称性を利用しています。

公開鍵には \(n\) が含まれますが、秘密鍵を求めるには事実上この分解が必要になります。

実務で使うRSA-2048の 2048 bit は、10 進数でおよそ 617 桁の合成数です。

紙と電卓で扱える大きさではありません。

筆者が CTF の初学者向けRSA問題を解説するときも、受講者が最初に戸惑うのは「mod を取りながら計算する意味」と「公開鍵と秘密鍵がなぜ対になっているのか」の二つです。

式だけ眺めると急に遠い話に見えますが、小さな数で一度最後まで辿ると、公開鍵暗号が“魔法”ではなく、整数論の上に立った手順であることが腹落ちします。

RSA鍵生成のミニ実演

では、手で追える大きさの例でRSAの鍵生成から暗号化、復号までを見ていきます。使う値は古典的な教科書例です。

まず素数を 2 つ選びます。

\[ p=61,\quad q=53 \]

これを掛けると法(modulus)である \(n\) が得られます。

\[ n=pq=61\times53=3233 \]

続いてオイラーのトーシェント関数 \(\varphi(n)\) を計算します。

\(p,q\) が素数なので、\(\varphi(n)=(p-1)(q-1)\) となります。

\[ \varphi(n)=(p-1)(q-1)=60\times52=3120 \]

ここで、\(\varphi(n)\) と互いに素な公開指数 \(e\) を選びます。例では

\[ e=17 \]

です。次に、\(ed\equiv1\pmod{3120}\) を満たす \(d\) を探します。これが秘密指数です。

\[ 17d\equiv1\pmod{3120} \]

この解は

\[ d=2753 \]

です。実際に確認すると、

\[ 17\times2753=46801=3120\times15+1 \]

となり、たしかに余りが 1 です。したがって公開鍵は \((n,e)=(3233,17)\)、秘密鍵は \((n,d)=(3233,2753)\) です。

次に平文を \(M=65\) として暗号化します。暗号文 \(C\) は

\[ C=M^e \bmod n = 65^{17}\bmod3233 \]

で求まります。

ここでそのまま \(65^{17}\) を計算しようとすると桁が膨れ上がるので、途中で mod 3233 を取りながら二乗を繰り返すのがコツです。

CTF でもここで詰まる人が多く、電卓に大きな数を入れて途中で表示が崩れたり、mod を取るタイミングを見失ったりします。

実際には次のように進めれば十分です。

\[ 65^2 = 4225 \equiv 992 \pmod{3233} \]

\[ 65^4 \equiv 992^2 = 984064 \equiv 1232 \pmod{3233} \]

\[ 65^8 \equiv 1232^2 = 1517824 \equiv 1547 \pmod{3233} \]

\[ 65^{16} \equiv 1547^2 = 2393209 \equiv 789 \pmod{3233} \]

\[ 65^{17} \equiv 65^{16}\cdot65 \equiv 789\cdot65 = 51285 \equiv 2790 \pmod{3233} \]

したがって暗号文は

\[ C=2790 \]

になります。

復号では秘密指数 \(d=2753\) を使って

\[ M=C^d \bmod n = 2790^{2753}\bmod3233 \]

を計算します。指数がさらに大きいので、これも平方反復法で進めます。途中結果を並べると次の通りです。

\[ 2790^1 \equiv 2790 \pmod{3233} \]

\[ 2790^2 \equiv 2269 \pmod{3233} \]

\[ 2790^4 \equiv 1425 \pmod{3233} \]

\[ 2790^8 \equiv 301 \pmod{3233} \]

\[ 2790^{16} \equiv 77 \pmod{3233} \]

\[ 2790^{32} \equiv 2696 \pmod{3233} \]

\[ 2790^{64} \equiv 632 \pmod{3233} \]

\[ 2790^{128} \equiv 1765 \pmod{3233} \]

\[ 2790^{256} \equiv 1846 \pmod{3233} \]

\[ 2790^{512} \equiv 134 \pmod{3233} \]

\[ 2790^{1024} \equiv 1791 \pmod{3233} \]

\[ 2790^{2048} \equiv 545 \pmod{3233} \]

2753 を 2 進数の和にすると

\[ 2753=2048+512+128+64+1 \]

なので、必要な項だけ掛け合わせます。

\[ 2790^{2753}\equiv 2790^{2048}\cdot2790^{512}\cdot2790^{128}\cdot2790^{64}\cdot2790^1 \pmod{3233} \]

\[ \equiv 545\cdot134\cdot1765\cdot632\cdot2790 \pmod{3233} \]

これを順に mod 3233 で計算すると、結果は以下の通りになります。

\[ 545\cdot134 \equiv 1904 \]

\[ 1904\cdot1765 \equiv 1473 \]

\[ 1473\cdot632 \equiv 3065 \]

\[ 3065\cdot2790 \equiv 65 \]

となって、平文

\[ M=65 \]

が戻ります。暗号化した値が、対応する秘密鍵でちゃんと元に戻るわけです。

この小さな例では全工程を追えますが、本番のRSAでは桁数が格段に増え、手作業や単純な試行では扱えなくなります。

それでも計算の骨格は同じです。

公開鍵に含まれる \(n\) は誰でも見られるのに、\(\varphi(n)\) や \(d\) を得るには元の素数 \(p,q\) を知らなければならない。

この一方向性がRSAの核です。

素因数分解の困難性と現状アルゴリズム

RSAの安全性は、「大きな整数を掛けること」と「その積を元の素数に分解すること」の難しさが釣り合っていないことに依存しています。

61 と 53 を掛けて 3233 を作るのは一瞬ですが、3233 だけ渡されて 61 と 53 を当てる側に回ると、作業の性質が変わります。

小さな数なら試し割りで済みますが、これが 2048 bit 級になると話は別です。

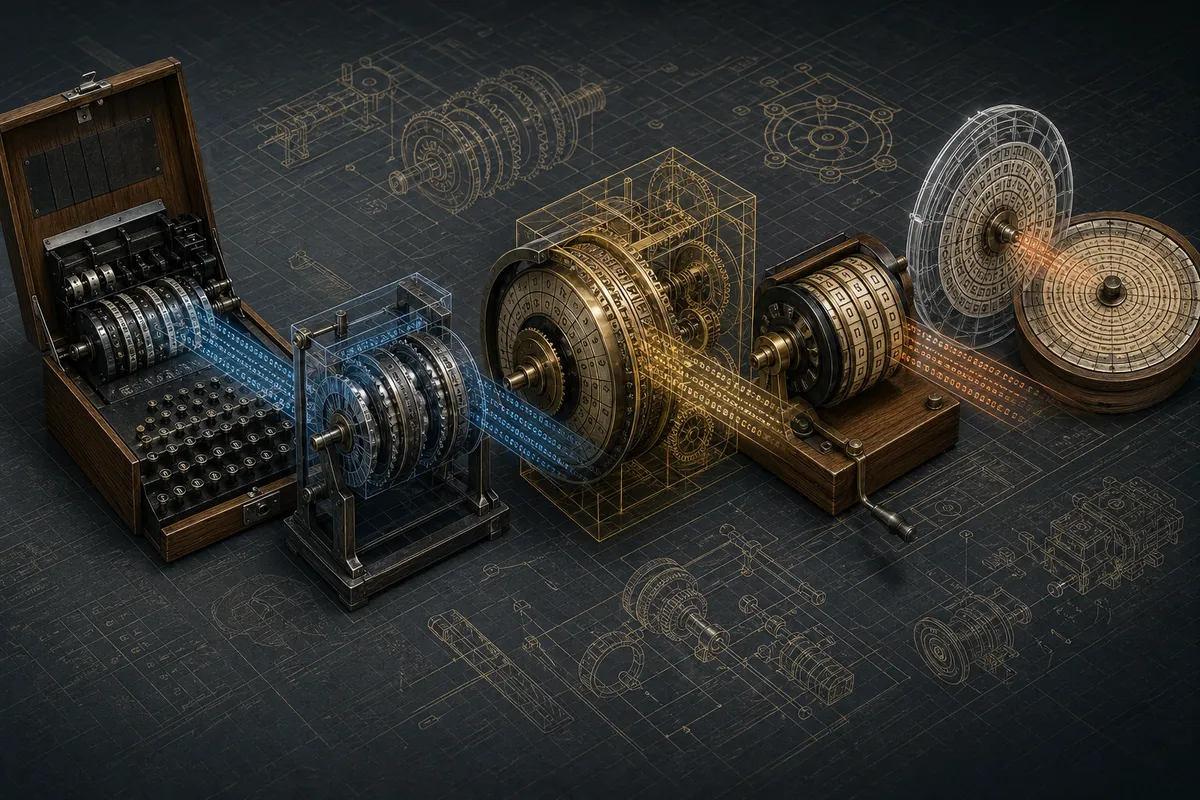

古典計算機の世界で、一般の大きな整数の素因数分解に対する代表的な最速手法は一般数体篩法です。

英語では General Number Field Sieve、略して GNFS と呼ばれます。

これは単純な総当たりではなく、合同式の大量収集や代数的な構造を使って分解を狙う洗練されたアルゴリズムです。

それでも、RSA-2048のようなおよそ 617 桁の合成数に対しては、依然として現実的な壁が厚いままです。

つまり、RSAは「誰も方法を思いついていないから安全」なのではなく、最善の既知アルゴリズムを当てても計算量が重いから安全だと言えます。

この点は、後で量子計算の話につなげるうえで欠かせません。

もし古典計算機でも多項式時間で素因数分解できる手法が見つかれば、RSAの前提は崩れます。

現状そうなっていないから広く使われてきました。

一方で量子計算では、Shorのアルゴリズムが素因数分解を多項式時間で解ける理論的可能性を示しました。

RSAにとって脅威なのは、公開鍵が漏れることではなく、公開鍵から秘密鍵を再構成する計算が、将来的には質的に軽くなる道筋が見えていることです。

言い換えると、RSAの安全性は数学の絶対的な不可能性に支えられているわけではありません。

計算資源を前提にした「現時点では届かない」という均衡の上に立っています。

だからこそ、素因数分解をどう解くかというアルゴリズム研究と、それを動かす計算機アーキテクチャの進歩が、そのままRSAの寿命に関わってきます。

ここを押さえておくと、量子コンピュータがなぜ公開鍵暗号の話題で繰り返し登場するのかが、数式の先にある実務感覚として見えてきます。

Shorのアルゴリズムは何を変えたのか

位数発見のアイデア

RSAを量子計算が脅かす、と聞くと「量子コンピュータは素因数分解を速くする機械なのだ」と受け取りがちです。

ですが、1994年にPeter Shorが示した本質はそこだけではありません。

核心にあるのは、素因数分解そのものを正面から解くのではなく、位数発見(order-finding)という周期の問題に落とし込むことです。

位数という言葉は少し硬く聞こえますが、直感は「ある操作を何回くり返すと、最初の形に戻るか」です。

たとえば時計の針を一定角度ずつ進めると、何回目かで元の位置に戻ります。

同じように、ある数を法 \(n\) の世界で何度も掛けていくと、値が巡回して周期を持ちます。

その周期が位数です。

Shorのアルゴリズムは、この「見えにくい周期」を量子的にあぶり出します。

筆者はこの説明をするとき、分数の小数展開を思い浮かべることがあります。

たとえば 1/7 は 0.142857142857… と同じ並びが繰り返されます。

目で追っていると、ただ長い列に見えても、少し引いて眺めると「6桁ごとの模様」があります。

位数も似ています。

値を一つひとつ順番に眺めていると雑然として見えますが、全体には周期が潜んでいる。

その周期成分を前に押し出すのが量子フーリエ変換(QFT)の役目です。

ここが暗号の美しいところなのですが、QFTは数を直接割ったり因数を当てたりするのではなく、ばらばらに見える変化から“繰り返しのリズム”を拾い上げるのです。

古典計算機でも周期を探すこと自体はできます。

ただ、候補を順に試していくと計算量が重くなります。

量子計算では重ね合わせを使って多くの候補を同時に扱い、QFTで周期の痕跡を高い確率で取り出せます。

理想化すれば、量子ビット \(n\) 個で \(2^n\) 個の状態空間を扱えるという量子計算の特徴が、この手の問題で効いてきます。

Shorの提案が衝撃だったのは、素因数分解の「難しさ」を別の問題へ写し替え、その写し替え先に量子計算がよくはまったからです。

RSA/DH/ECCへの影響

この性質が重いのは、RSAだけの問題で終わらないからです。

RSAは素因数分解の困難さに立っていますが、Diffie–HellmanやECCは離散対数問題の難しさに立っています。

そしてShorのアルゴリズムは、素因数分解だけでなく離散対数問題にも同系統の方法で効くため、公開鍵暗号の広い範囲に影響が及びます。

実務で見ると、この射程は大きいです。

RSAは証明書や電子署名の文脈で長く使われ、DHは鍵共有、ECCはモバイルやTLSのような通信路保護で広く採用されてきました。

古典計算機の世界では、それぞれ別の数学的困難さに支えられているように見えても、量子計算の側から見ると「周期や位相を取り出せる構造を持つ問題群」として一気に視界に入ります。

直感に反するかもしれませんが、量子時代にはRSAからECCへ置き換えれば安泰、とは言えません。

この点が、ポスト量子暗号への移行がRSA対策だけで済まない理由です。

ECCは鍵サイズが小さく効率もよいため、RSAの代替として長く有力でした。

しかし量子攻撃の観点では、ECCも安全圏には残りません。

だから現在の移行先として注目されているのは、格子問題やハッシュベース署名のように、Shor型の加速がそのまま通用しない構造を持つ方式です。

ML-KEMやML-DSAが標準化された背景も、ここにあります。

共通鍵との違い

ここで、公開鍵暗号と共通鍵暗号を同じ「量子に弱い暗号」とひとまとめにしないことが欠かせません。

AESのような共通鍵暗号は、Shorの直接の標的ではありません。

Shorが効くのは、素因数分解や離散対数のような代数的構造を持つ問題です。

共通鍵の鍵探索は性質が違い、主役になるのはGrover型の探索加速です。

この違いはインパクトの質に表れます。

公開鍵暗号では、Shorが使えると安全性の前提そのものが崩れます。

いっぽう共通鍵では、Groverによる加速は総当たり探索を平方根ぶん速くするにとどまります。

たとえばAES-128は量子攻撃下で概念的には 64 bit 相当まで目減りするので、鍵長をAES-256へ引き上げるという対処が成り立ちます。

つまり共通鍵は設計思想を丸ごと捨てるというより、鍵長の再設定で耐性を持たせやすいのです。

💡 Tip

量子時代の影響を整理すると、公開鍵暗号は「安全性の土台が崩れる」側で、共通鍵暗号は「必要な強度を確保するために鍵長を増やす」側です。同じ量子脅威でも、受けるダメージの種類が違います。

この区別を押さえると、「量子コンピュータが来たら暗号は全部終わる」という雑な理解を避けられます。

実際に見直しの優先順位が高いのは、RSADHECCのような公開鍵基盤です。

量子計算の登場が変えたのは、暗号全体を一様に弱くしたことではなく、どの数学が崩れ、どの数学がまだ踏みとどまるかという地図そのものでした。

公開鍵と共通鍵——量子の影響の違い

公開鍵

量子計算の影響を考えるとき、いちばん先に切り分けるべきなのが公開鍵暗号です。

RSAは素因数分解の困難さ、ECCは楕円曲線上の離散対数問題の困難さを土台にしています。

ところが、この2つはShorのアルゴリズムの射程に入ります。

前述の通り、ここで起きるのは「少し弱くなる」ではなく、安全性の根拠そのものが別の計算モデルでは崩れるという質の違いです。

この点は、現場で方式選定を眺めていると実感しやすいところです。

古典計算の時代には、RSA-2048とECCは性能や鍵サイズのバランスを見ながら選ぶ関係でした。

しかし量子計算を軸に置くと、その比較軸自体が変わります。

RSAよりECCのほうが軽いから移ればよい、という整理では足りません。

量子攻撃の前では、両者とも同じカテゴリで再評価する必要があるからです。

そこで移行先として浮上するのが、量子攻撃を前提に設計されたPQCです。

鍵共有ではML-KEM、署名ではML-DSAのように、格子問題を土台にした方式が標準化されています。

CRYSTALS-Kyber由来のML-KEMは、たとえばML-KEM-768で公開鍵が1,184バイト、暗号文が1,088バイトです。

古典的なECCに比べると軽量とは言いませんが、公開鍵基盤を量子時代へ運ぶための現実的な落としどころとして位置づけられています。

筆者はこの数字を見ると、暗号理論の話がそのままネットワーク設計や証明書運用の話に降りてくる感覚があります。

数学の置き換えは、パケットや保存領域の置き換えでもあるわけです。

ここで整理したいのは、「公開鍵を全部すぐ入れ替えるか」「何もしないか」という単純な二択ではないという点です。

実務では段階的な準備がいちばん筋が通っています。

長期秘匿が必要なデータを優先し、証明書、鍵交換、署名基盤の順に棚卸ししながら、RSAやECCが残っている場所を洗い出していく。

この順番になるのは、量子計算の影響が公開鍵でまず臨界点を迎えるからです。

比較を一枚で見渡すと、論点がぶれません。

| 項目 | 公開鍵の従来方式 | 量子時代の見方 | 推奨アクション |

|---|---|---|---|

| RSA | 素因数分解の困難さに依存 | Shorで理論上破られる | 長期利用を前提にせず、ML-KEMML-DSA系への移行計画を進める |

| ECC | 離散対数問題の困難さに依存 | Shor系で理論上破られる | RSAの代替として固定せず、PQC前提で再設計する |

| PQC | 格子・ハッシュなど量子耐性を想定 | 量子攻撃を前提に設計 | 新規導入や更新時の候補として採用を検討する |

共通鍵

共通鍵暗号は、公開鍵暗号とは受ける打撃の種類が違います。

AESのような方式に対して主に意識するのはShorではなくGroverです。

これは未構造探索、つまり総当たり探索を平方根ぶん短縮する量子アルゴリズムです。

直感的には、鍵空間が \(N\) 個あるとき、古典計算では \(N\) に比例する探索が、量子計算では \(\sqrt{N}\) に縮むイメージです。

そのため、AES-128は量子攻撃下では概念的に \(2^{64}\) 回規模の探索に相当します。

一方、AES-256は \(2^{128}\) 回規模に相当します。

筆者はこの差を説明するとき、数字の並びの長さよりも「探索の景色」がまるで変わる点を強調します。

\(2^{64}\) は日常感覚から見れば天文学的ですが、暗号の世界では「手が届く未来を議論し始める大きさ」です。

いっぽう \(2^{128}\) は、その先にもう一段ではなく、桁違いの深さがあります。

AES-128とAES-256は、鍵長が2倍だから余裕も2倍、という関係ではありません。

量子探索まで含めて考えると、安全余裕の地形そのものが別物です。

この違いがあるので、共通鍵では「方式を捨てる」より「鍵長を引き上げる」が中心戦略になります。

AES自体の設計がShorで崩れるわけではないためです。

公開鍵のように土台の数学がひっくり返るのではなく、必要な強度を見積もって鍵長を再設定する。

ここが、量子時代の暗号設計でいちばん誤解されやすい点です。

現場感覚でも、AES-256への移行は公開鍵基盤の全面改修よりずっと扱いやすい部類に入ります。

アプリケーション、ストレージ、VPN、バックアップ暗号化など、すでにAESを前提にしている場所が多く、鍵長の見直しで済む領域が広いからです。

もちろん運用上は性能や互換性も見ますが、論点の芯はそこではありません。

量子計算に対して、共通鍵は延命策ではなく、鍵長の再調整でまだ戦えるカテゴリにあります。

比較表にすると、公開鍵との違いがはっきり見えます。

| 項目 | 共通鍵の従来方式 | 量子時代の見方 | 推奨アクション |

|---|---|---|---|

| AES-128 | 128ビット鍵で総当たり耐性を確保 | Grover下で概念的に 64ビット相当 | 長期保護や高機密用途では上位鍵長へ切り替える |

| AES-256 | 256ビット鍵で広い安全余裕を確保 | Grover下で概念的に 128ビット相当 | 量子時代を見据えた共通鍵の有力な基準になる |

| 共通鍵全般 | 総当たり耐性が中心 | 平方根高速化の影響を受ける | 方式廃止より鍵長の再設計を優先する |

ハッシュと電子署名の観点

ハッシュ関数にも量子計算の影響は及びますが、見方は少し繊細です。

ハッシュには「ある入力から同じ出力を探す原像探索」と「異なる2つの入力で同じ値にぶつける衝突探索」があります。

量子計算はこの探索にも加速を与えますが、公開鍵のRSAやECCのように、ある日を境に設計原理が失効するという形ではありません。

ここでも、探索の複雑さがどこまで縮むかを見極める話になります。

電子署名では、このハッシュの性質がそのまま方式選定に響きます。

たとえば署名方式の多くはハッシュ関数を内部で使っており、量子時代には署名アルゴリズム本体だけでなく、組み合わせるハッシュ強度も含めて見直す必要があります。

その文脈で存在感を持つのがハッシュベース署名です。

SPHINCS+はこの代表例で、NIST標準ではSLH-DSAとして整理されています。

安全性の根拠が素因数分解や離散対数ではなく、ハッシュ関数の性質に強く結びついているため、Shor型の直撃を受けません。

筆者がSPHINCS+を面白いと感じるのは、量子時代に「何を安全性の土台として残すか」という問いへの、きわめて正面からの答えになっているからです。

代償も明快で、署名サイズはML-DSAより大きくなりやすく、数KBから数十KBのレンジに入ります。

これは証明書、ファームウェア署名、更新配布の設計にそのまま跳ね返ります。

理論上の安心感だけでなく、配る・保存する・検証するという実装の現実まで含めて選ぶ必要があります。

署名とハッシュをまとめて見える化すると、選択の軸が揃います。

| 項目 | 古典的な主力 | 量子時代の影響 | 推奨アクション |

|---|---|---|---|

| 電子署名 | RSA署名、ECDSAなど | Shor系で理論上破られる | 新規設計ではML-DSAや用途に応じてSPHINCS+を候補に置く |

| ハッシュ関数 | SHA-2SHA-3系 | 原像探索・衝突探索で量子加速の影響を考慮 | 必要強度に応じて出力長を見直す |

| ハッシュベース署名 | SPHINCS+ | Shorの直撃を受けない構造 | 署名サイズ増と引き換えに堅牢な選択肢となる |

公開鍵、共通鍵、ハッシュ・署名を並べてみると、量子計算の脅威は一様ではありません。

公開鍵では土台の交代が必要になり、共通鍵では鍵長の再設定が中心になり、署名では方式本体とハッシュの両面を同時に見ることになります。

同じ「量子の影響」という言葉でも、壊れ方の種類が違う。

この見取り図を持っていると、RSAの話からAESやSPHINCS+の話へ移っても、論点が散らばりません。

では、RSAはいつ危ないのか——理論と現実のギャップ

現在の量子ハードの実力

ここで切り分けたいのは、ShorでRSAが理論上破れることと、いま手元にある量子計算機でRSA-2048を攻撃できることは別問題だ、という点です。

暗号の議論ではこの2つが混ざりやすいのですが、現場ではまったく違う意味を持ちます。

2025年時点の量子ハードウェアは、いわゆるNISQ段階にあります。

雑音が多く、計算途中で誤りが入りやすい世代です。

量子ビット数だけを見ると派手に見えますが、暗号解読の現実性を左右するのはそれだけではありません。

二量子ビットゲートの忠実度、どこまで深い回路を崩さず実行できるか、計算を止めずにどれだけ連続稼働できるか、そうした条件がそろって初めて意味を持ちます。

直感に反するかもしれませんが、量子ビット数が増えたことと、RSAを割れることの間には長い距離があります。

国内では富士通と理化学研究所が256量子ビットの超伝導量子コンピュータを公表しており、2026年には1,000量子ビット級を目標に置いています。

IBMも2026年に120量子ビットで約5,000 two-qubit gates 級の計画を示しています。

こうした数字は着実な前進ですが、暗号解読の文脈で読むときは「量子ビット数」だけで拍手しないことが肝心です。

RSA-2048級の素因数分解では、回路の深さも、誤りの蓄積も、要求される継続時間も、今の公開ロードマップよりはるかに厳しいからです。

筆者は暗号実装の検証をしていた頃から、性能表でまず見る場所が「台数」や「コア数」ではなく、その処理を最後まで完走できる条件でした。

量子計算機も感覚は似ています。

ベンチマークとして数千ゲート、あるいは万ゲート級の処理を安定して回せることと、暗号破りに必要な桁の論理ゲートを崩さず流し切ることの間には、同じ「計算」という言葉では括れない断絶があります。

その差をつかみやすいように、あえて粗い比較表にすると次のようになります。

| 観点 | 現状機の目安 | RSA-2048解読級で問題になる水準 |

|---|---|---|

| 実行できるゲート規模の感覚 | 数千〜万ゲート規模 | 論理ゲートは桁違いに多い |

| 誤りの影響 | 途中で蓄積しやすい | 長時間計算なので累積誤りを強く抑える必要がある |

| 量子ビットの見方 | 物理量子ビット数が前面に出る | 論理量子ビットを何個、どれだけ安定維持できるかが焦点 |

| 暗号への脅威 | 小さな半素数の実験段階 | 実用鍵長への攻撃には総合性能が足りない |

この表は厳密な資源計算表ではありませんが、桁の差を見るには十分です。

「今ある量子機はすごい」ことと、「今すぐRSAが危ない」ことは同義ではない。

この一点を外さないと、量子ニュースの読み方を誤ります。

誤り訂正と論理量子ビット

量子コンピュータの現実性を語るとき、避けて通れないのが誤り訂正です。

量子ビットは外乱に弱く、放っておくと状態が崩れます。

そこで多数の不安定な量子ビットを束ねて、1つの安定した計算単位として使う考え方が必要になります。

これが物理量子ビットと論理量子ビットの違いです。

物理量子ビットは、実際のハード上に存在する生の量子ビットです。

論理量子ビットは、それらを誤り訂正で包んで得る、計算上使いたい「信頼できる量子ビット」です。

暗号解読に必要なのは後者であり、ニュース見出しに出る量子ビット数の多くは前者です。

ここがいちばん誤解されやすいところです。

たとえばShorの理論図では、必要な量子ビット数が比較的コンパクトに見えることがあります。

ところが実機では、各ゲートで誤りが入り、深い回路ほど成功率が落ちるため、そのままでは走りません。

誤り訂正を入れると、1個の論理量子ビットを得るために多数の物理量子ビットが必要になります。

さらに、論理ゲート自体の実行にも追加コストがかかります。

つまり、理論のアルゴリズム図に書かれた必要量子ビット数は、現実の機械で必要なハード規模の下限にすぎないわけです。

ここが暗号の美しいところなのですが、数学の側では「多項式時間で解ける」と言えた瞬間に景色が変わります。

けれど工学の側では、誤り訂正を入れた瞬間に別の山が立ち上がります。

RSAに対する量子脅威は、この数学上の突破と工学上の実装可能性が重なったときに初めて現実の攻撃力になります。

💡 Tip

量子ビット数=解読力ではありません。暗号解読の現実性は、ゲート誤り率、回路の深さ、連続稼働時間、誤り訂正のオーバーヘッドをまとめて見ないと判断できません。

このため、ロードマップを見るときも「何量子ビットか」だけでは足りません。

IBMが示している約5,000 two-qubit gates 級という計画値は、まさにこの文脈で読むべき数字です。

暗号解読では、単に量子ビットが並んでいるだけでなく、高忠実度の二量子ビットゲートを十分な深さまで積み上げられるかが勝負になるからです。

資源見積もりと専門家予測の幅

RSA解読に必要な資源見積もりは、ひとつの固定値ではありません。

前提をどう置くかで、必要な量子ビット数も所要時間も動きます。

ここを単純化しすぎると、「まだ何十年も先だ」という楽観か、「もう秒読みだ」という悲観のどちらかに振れがちです。

実際にはその中間に広い帯があります。

一方で、報道や一部の研究で示された低位推計では、誤り訂正方式、ゲート誤り率、物理→論理量子ビット換算係数、回路深さなどの前提を変えると必要な物理量子ビット数や所要時間が大きく下がるとされることがあります(例として 100万 未満の noisy qubits で数日〜数週間とする報告が挙げられる場合があります)。

こうした推計を引用する際は、必ず出典と主要な前提条件(誤り率、誤り訂正方式、換算係数、回路深さ等)を明示してください。

だからこそ、「理論上破れる」は軽視できず、「現実に攻撃可能」はまだ到達していない、という二段階の理解が要ります。

RSAの危険はゼロではなく、同時に、今日の量子ハードを見て即座に運用停止と結論づける話でもありません。

理論と現実の間には、誤り訂正と工学的制約がつくる厚い層がある。

その層が薄くなる速度について、専門家の見立てがまだ割れているというのが、いま最も正確な描写です。

今すぐ起きるリスクはHarvest now, decrypt later

HNDLとは何か

ここで見ておきたいのがHarvest now, decrypt later、略してHNDLです。

意味はそのままで、いまは読めない暗号通信を先に収集して保存し、将来の計算資源で解読するという攻撃モデルです。

直感に反するかもしれませんが、攻撃者にとって大切なのは「今日すぐ読めること」ではありません。

あとで読めれば価値が残る情報なら、今日のうちに回収しておく理由があるのです。

この発想が効くのは、現在のTLSやVPN、各種の公開鍵基盤が、前のセクションまでで見た通りRSAやECCの安全性に依存している場面がまだ広いからです。

通信経路上で暗号化されていても、やり取りそのものを記録されれば、将来その鍵交換や署名検証の前提が崩れた時点で、保存済みデータが一気に平文へ近づきます。

つまり脅威は「量子計算機が完成した日」から始まるのではなく、保存が始まった日から静かに進行すると捉えたほうが正確です。

筆者はこの話を机上の未来論としてではなく、データ保護の時間軸の問題として見るべきだと考えています。

たとえば契約文書、医療記録、研究データ、個人の詳細な通信履歴は、今日の価値より10年後の価値のほうが高いことすらあります。

技術ロードマップの予測幅が広くても、保存されたデータは待ってくれません。

だからHNDLでは、「いつ解読されるか」だけでなく、その情報は何年秘密である必要があるかが判断軸になります。

長期秘匿データの洗い出し

HNDLへの対応で優先順位が高いのは、保存期間が長く、後日読まれても被害が残るデータです。

典型例としては、医療情報、金融取引の詳細、政府文書、機微な研究データ、設計図や製法のような知的財産、個人の通信履歴や位置・行動の蓄積が挙がります。

これらは漏えいした瞬間だけでなく、何年後に明るみに出ても損害が消えないという共通点を持っています。

現場で棚卸しをするとき、筆者はデータの「機密性」だけで分類すると抜け漏れが出ると感じてきました。

効くのは、保存年限を先に切る方法です。

実務では、システム名、データ種別、保管場所、法令や契約上の保存年限、業務上の実質保存年限を書き出し、そのうえで“10年以上残るもの”を赤で塗るだけでも景色が変わります。

赤が付いた行には、診療記録、融資関連書類、研究アーカイブ、退職者を含む人事データ、監査証跡、長期保管バックアップが並びやすく、量子時代の優先対象が一目で見えてきます。

ここが暗号の美しいところなのですが、アルゴリズムの話を資産台帳に落とした瞬間、抽象論がそのまま運用課題へ変わります。

長期秘匿データが優先される理由は単純です。

秘密でいてほしい期間が、暗号方式の寿命を上回る可能性があるからです。

今日の通信が安全でも、その保護期間が15年、20年に及ぶなら、将来の解読能力を無視できません。

逆に、数日で価値が薄れる一時的なデータと、10年以上保護が必要なデータを同じ強度・同じ移行順で扱うと、予算も人手も薄まります。

段階的準備が現実的とされるのはこのためで、全部を一度に変えるのではなく、長く秘密であるべきものから先に守り方を変えるのが筋の良い進め方です。

長期秘匿データが優先される理由は単純です。

秘密でいてほしい期間が、暗号方式の寿命を上回る可能性があるからです。

今日の通信が安全でも、その保護期間が15年、20年に及ぶなら、将来の解読能力を無視できません。

保存済みトラフィックやバックアップが収集されれば、将来のアルゴリズム改変で一気に価値が戻るおそれがあります。

企業システムでは、証明書運用やVPNまわりの長期保存が裏目に出る場面もあります。

証明書そのもの、鍵更新の履歴、接続ログ、バックアップ、アーカイブされた設定ファイルが長く残っていると、あとから見たときに攻撃の補助線になります。

暗号化された本体だけでなく、いつ、誰が、どこへ、どの方式で接続していたかという周辺情報が豊富に残るほど、後日解読の価値は上がります。

機密研究ネットワークや行政系の閉域接続では、この周辺情報の蓄積が通信本文と同じくらい重い意味を持ちます。

対策の方向性も、時間軸で整理すると見通しが立ちます。

通信中のデータには、古典方式とPQCを組み合わせたハイブリッド鍵交換が有効です。

たとえば既存の楕円曲線系にML‑KEMを重ねる設計なら、移行途中でも一方の前提だけに依存しない構成がとれます。

保存データには長期保管アーカイブの再暗号化計画が欠かせません。

何を何年残すのか、鍵をどこで更新するのか、どのバックアップ世代まで巻き取るのかを決めておかないと、現役系だけ更新して古い保管庫が取り残されます。

あわせて、データ生成から保管・複製・廃棄までを追うライフサイクル管理を導入すると、不要に残り続けるデータを減らせます。

現実的な対策——PQC移行と暗号アジリティ

PQCとはと標準化の現在地

'PQC'(post-quantum cryptography)は、量子計算機による攻撃を前提に設計された公開鍵暗号群です。

対象は主に鍵共有と電子署名で、格子問題やハッシュベースなど、量子アルゴリズムに対して耐性が期待される数学的土台を使う方式が中心になります。

PQC(post‑quantum cryptography)の標準化は進展しています。

NIST は2024年ごろから関連文書を順次公開し、鍵共有や署名に関する仕様化が進んでいます。

ただし、FIPS 文書の最終発行日や正式名称を断定する場合は、該当の一次資料(各 FIPS の PDF 等)を直接確認してください。

位置づけも整理しておくと判断しやすくなります。

鍵交換やセッション鍵確立の主役はML-KEMで、もともとのCRYSTALS-Kyber系です。

署名はML-DSAが中核で、こちらはCRYSTALS-Dilithium系です。

もうひとつの署名方式SLH-DSAはSPHINCS+を標準化したもので、ハッシュベースという異なる系統を持っています。

筆者はこの構図を、通信路を作る鍵共有はML-KEM、証明書やコード署名の更新先はまずML-DSA、アルゴリズム多様性を確保したい場面ではSLH-DSAも視野に入る、と捉えると整理しやすいと感じています。

NISTの標準化はそこで止まっていません。

2025年3月には追加の鍵カプセル化方式としてHQCの選定が公表され、PQCの実務は「一つの勝者を固定して終わり」ではなく、複数方式を見ながら運用していく段階へ入っています。

ここが暗号の美しいところなのですが、標準化が進むほど、実務側には逆に「将来の差し替えを前提に設計する」という発想が必要になります。

標準が固まったから固定実装でよい、ではなく、標準が増えるからこそ入れ替え可能性を持たせるべきです。

時系列で見ると、米国は2022年に移行方針を示し、その後関連文書やガイダンスが順次公開されつつあります。

日本でも2035年を一つの目安としてPQC移行を進める方向性が共有されています。

NIST は2024年ごろから PQC に関する関連文書を順次公開し、標準化作業が進展しています。

ただし FIPS 文書の最終発行日や正式な確定年を断定する場合は、該当する一次資料(NIST の各 FIPS PDF)を参照してください。

参考: NIST PQC プロジェクト

棚卸しでは、少なくとも次の観点が必要です。

- どのシステムがRSAECDSAECDHEdDSAを使っているかを把握する

- 鍵交換、サーバー証明書、クライアント証明書、コード署名、文書署名のどこに公開鍵暗号があるかを特定する

- 終端装置がどこにあるか(CDN、ロードバランサ、WAF、アプリサーバ、メールゲートウェイ、リモートアクセス装置まで含めて)を確認する

- 鍵と証明書を誰が発行し、どこで保管し、どのHSMやKMSに載せているかを明確にする

- 保存期間が長いデータに関わる通信や署名がどれか

筆者はこの棚卸しを、資産管理台帳というより「暗号の依存関係マップ」として作ることが多いです。

表の列は多くなくて構いません。

システム名、用途、使っている方式、終端製品名、証明書の発行元、鍵保管先、保護対象データの保存年限、この程度でも全体像は見えてきます。

とくに長期秘匿データと結びつく経路に印を付けると、移行の優先順位が自然に決まります。

前のセクションで触れたHNDLの観点が、ここで具体的な台帳項目に変わります。

優先順位付けでは、「止まると困る基盤」より「あとから読まれると困る基盤」を先に見るのが筋です。

たとえば外部公開APIのTLS、研究データの転送、長期保存アーカイブへのアップロード経路、役員向けVPN、機微な業務文書の署名系は、影響範囲だけでなく保護期間の長さで順位が上がります。

逆に、短命な一時データだけを扱う系は後ろに置けます。

移行を成功させるチームは、業務クリティカル度と秘密保持年限の二軸で切っています。

ベンダー確認も早い段階で必要です。

ここでいう確認は一般論ではなく、製品名ごとのロードマップ確認です。

TLS終端装置なら、ハイブリッド鍵共有への対応予定、利用可能なPQCグループ、証明書サイズ増加時の制限が論点になります。

VPNなら IKE や鍵交換方式の拡張計画、HSMならML-KEMML-DSAの生成・保管・署名処理への対応、PKIならPQC証明書の発行・検証・失効運用、SDKならモバイルや組み込み側のライブラリ更新計画が焦点です。

筆者なら、ベンダーへの問い合わせは次の質問に絞ります。

- TLS終端がML-KEM単独または古典方式とのハイブリッド鍵共有を扱えるかを確認する

- ハンドシェイク増分と証明書サイズ増分を見込んだ設定変更が必要かを検討する

- VPN製品がPQC対応の鍵交換をどのプロトコルで実装予定かを確認する

- HSMがML-DSA署名鍵とML-KEM関連鍵素材をネイティブに扱えるかを確認する

- PKI製品がPQC証明書の発行、失効、監査ログまで一連で回せるかを確認する

- 社内利用中の暗号ライブラリやSDKに、旧名称ではなくML-KEMML-DSASLH-DSA名でのサポート計画があるか

💡 Tip

棚卸しで抜けやすいのは、公開Webだけではなく、社内TLS、バックアップ製品の管理通信、複合機やネットワーク機器の管理証明書、コード署名基盤、モバイルアプリ内SDKです。攻撃面より更新面で詰まりやすい場所から先に見つけると、移行計画の現実味が一段上がります。

ハイブリッド導入と暗号アジリティ

移行の進め方として最も現実的なのは、古典方式をすぐ全廃することでも、様子見で何もしないことでもなく、ハイブリッド導入です。

従来のX25519や既存の証明書運用を残しつつ、ML-KEMやML-DSAを組み合わせる段階を設けるやり方です。

通信では古典方式とPQC方式の両方から鍵素材を得る構成が取りやすく、過渡期の相互運用も確保しやすくなります。

筆者の感覚では、この方式は「全部を変える計画」ではなく「止めずに入れ替える計画」として説明すると現場に通ります。

TLSへの影響はまず鍵共有です。

たとえばML-KEM-768をハンドシェイクに組み込むと、暗号文だけで約1.1KBの転送増分が乗ります。

これ自体は1回のハンドシェイクとしては吸収できる場面が多いのですが、証明書までPQC化すると話が変わります。

ML-DSA系の公開鍵と署名をX.509へ載せると、証明書は数KB単位で膨らみます。

代表例としてDilithium3相当の値を置くと、公開鍵約1,952Bと署名約3,293Bだけで合計約5.1KBになり、ASN.1のオーバーヘッドまで含めると、証明書1枚の増分が体感でもはっきり見える水準になります。

PQC移行はアルゴリズムの話であると同時に、通信サイズ、証明書配送、キャッシュ、MTU、ログ保管量の話でもあります。

この影響はPKIと鍵管理にそのまま波及します。

証明書チェーンが太くなると、発行系、失効情報、監査ログ、証明書配布の挙動まで見直しが要ります。

HSMでは鍵や署名オブジェクトのサイズ増加が保管設計に響きますし、バックアップやレプリケーションの単位にも影響します。

すでにThales Luna HSMではML-KEMML-DSAのネイティブ対応が示され、AWSやGoogle CloudもKMSやHSM系での対応計画を打ち出しています。

ここで見るべきなのは「PQC対応済み」という宣伝文句ではなく、どの規格名に対応しているか、生成・保管・署名・インポート・エクスポートのどこまでカバーしているかです。

検証環境での相互運用試験も欠かせません。

OpenSSL本体への組み込みは過渡期にあり、いまの試験実装ではliboqsやoqs-providerを使った検証が実務の入口になります。

筆者はこの手の検証で、アルゴリズムそのものよりも、証明書パーサ、ロードバランサ、監視製品、フォレンジック用ログ基盤が先に詰まる場面を多く見ます。

PQC化で失敗する理由は「暗号が難しいから」ではなく、周辺製品がこれまで想定していたサイズやOIDの前提を超えるからです。

そこで効いてくるのが暗号アジリティです。

これは、将来のアルゴリズム差し替えを前提に、プロトコル選択、実装、鍵管理、設定配布をモジュール化しておく考え方です。

具体的には、アプリケーションがRSAやECDSAの名前を直接抱え込まず、抽象化された署名API越しに動くこと、証明書プロファイルや鍵種別を設定で切り替えられること、鍵管理システムがアルゴリズム別のライフサイクルを分けて扱えることが効きます。

HQCのような追加方式が選ばれた事実は、この設計思想が机上論ではないことを示しています。

今後も方式の追加や置換は起こりうるので、固定実装は将来の負債になりやすいのです。

実務の流れを一列に並べるなら、暗号資産の棚卸し、長期秘匿データの優先順位付け、古典方式とPQCのハイブリッド導入、検証環境での相互運用テスト、本番展開という順になります。

この順序には理由があります。

棚卸し前にPoCをしても対象が定まらず、優先順位なしに本番展開すると長期保護が必要な系を取り逃し、ハイブリッド段階を飛ばすと互換性問題が一気に噴き出します。

PQC移行は新方式の採用競争ではなく、差し替え可能な暗号基盤を作る整備作業として進めると、途中で計画がぶれません。

まとめ:RSAの終わりではなく、公開鍵暗号の世代交代

今日の要点

RSAは明日から使い物にならなくなる技術ではありません。

いま壊れているのではなく、長く守りたい情報から順に前提が変わり始めている、という理解がいちばん実務に合います。

筆者は暗号の話で極端な結論が先に広がる場面を何度も見てきましたが、現場で本当に困るのは「全部そのまま」と「全部入れ替え」の両極端です。

現実の答えは、その間にある段階的な世代交代です。

公開鍵暗号の中心がRSAやECCから、量子時代を見据えたML-KEMML-DSASLH-DSAへ少しずつ移っていく流れは、すでに標準化、実装、製品対応の各層で始まっています。

つまり問うべきは「RSAは終わったのか」ではなく、「自分の組織のどこから先に置き換えるべきか」です。

とくにHNDLの観点では、今日は読めなくても将来読める形で保存されるデータが対象になるため、長期秘匿データを抱える組織ほど準備を先送りできません。

今後の指標

今後の見方としては、量子コンピュータのニュースを量子ビット数だけで追わないことが肝心です。

見るべきなのは、量子ゲートの忠実度、二量子ビットゲートをどこまで安定して積めるか、誤り訂正で実用的な突破が出るかという、「RSA級の問題に届く計算の質」です。

IBMのロードマップで示される two-qubit gates の拡大や、富士通と理研の量子ビット規模の進展は、単なる話題ではなく、実務側の移行時計を少しずつ早める材料になります。

同時に、制度と製品の動きも追う価値があります。

NISTの標準群、NSAのCNSA 2.0、日本政府の移行指針、そしてAWSGoogle CloudThalesのような主要クラウドや鍵管理基盤のPQC対応です。

筆者の経験では、暗号方式の理論的成熟より先に、調達要件、監査要件、サポート要件の更新で現場が動き始めます。

技術ニュースだけでなく、標準・政府方針・ベンダーロードマップの3本を同時に見ると判断を誤りにくくなります。

次の一歩チェックリスト

読むだけで終わらせないなら、着手点はこの5つに絞れます。最初の1週間でここまで進めると、HNDL対策は机上論から実務に変わります。

- 暗号資産を棚卸しし、RSAECCが残る通信、証明書、署名、鍵管理の場所を洗い出す

- 長期秘匿データを特定し、将来解読されると困る保存年限と保存経路を確認する

- 利用中の製品でML-KEMML-DSASLH-DSAへの対応計画を確認し、新規導入では暗号アジリティを要件に入れる

筆者なら初週は、1日目に対象システム一覧を作り、2日目に長期保存データを分類し、3日目から5日目でHSMPKITLS終端の製品名ごとにPQCロードマップを確認します。

そこで詰まった場所が、そのまま移行のボトルネックです。

公開鍵暗号の主役交代は、遠い未来の理論ではなく、資産管理の粒度で差が出るテーマです。

関連記事

共通鍵暗号と公開鍵暗号の違い|図解で仕組み比較

ブラウザでHTTPSのサイトを開いた瞬間、画面には見えないところで「いま誰と鍵を決めたのか」と「その後の本文をどの鍵で守るのか」が一気に走ります。この記事では、まず共通鍵暗号の仕組みと量子コンピュータ時代に何が変わるかの節を先に参照すると、以降の議論の流れがつかみやすくなります。

AES暗号とは?歴史・仕組み・GCMまで

WebをHTTPSで開き、Wi‑Fiに接続し、ノートPCのディスク暗号化を有効にする。ふだん何気なく触れているこの3つの動作の奥には、同じ名前の暗号がいます。

公開鍵暗号の仕組みとRSAの原理図解

ブラウザの錠前アイコンを開いて証明書の詳細をのぞくと、Public-Key: RSA 2048 と Exponent: 65537 が並んでいて、公開鍵暗号は教科書の中だけの話ではなく、いま目の前の通信を支える現役技術なのだと実感します。

RSA暗号とは?素因数分解と公開鍵の仕組み

1977年に公開されたRSAは、公開してよい鍵(n, e)と外に出してはいけない秘密鍵dを分けることで、暗号と署名の考え方を一段進めた方式です。公開鍵暗号を数式から理解したい人、仕組みは知っているのに実務での役割が曖昧な人に向けて、歴史的位置づけから手で追える計算例までを一本につなげます。